Kann man Kriminalität an Gesichtern ablesen?

Studieder Shanghai

Jiao Tong

University

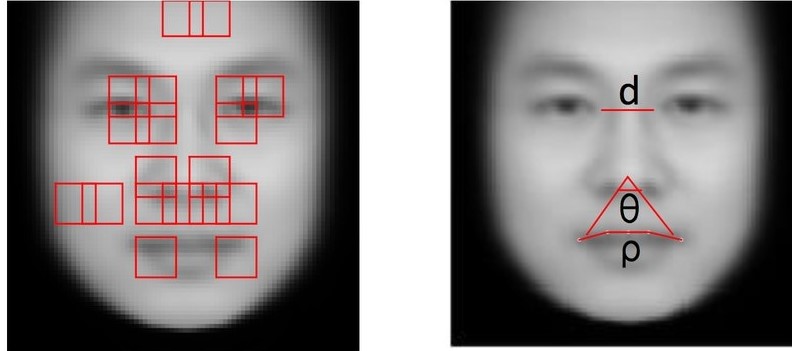

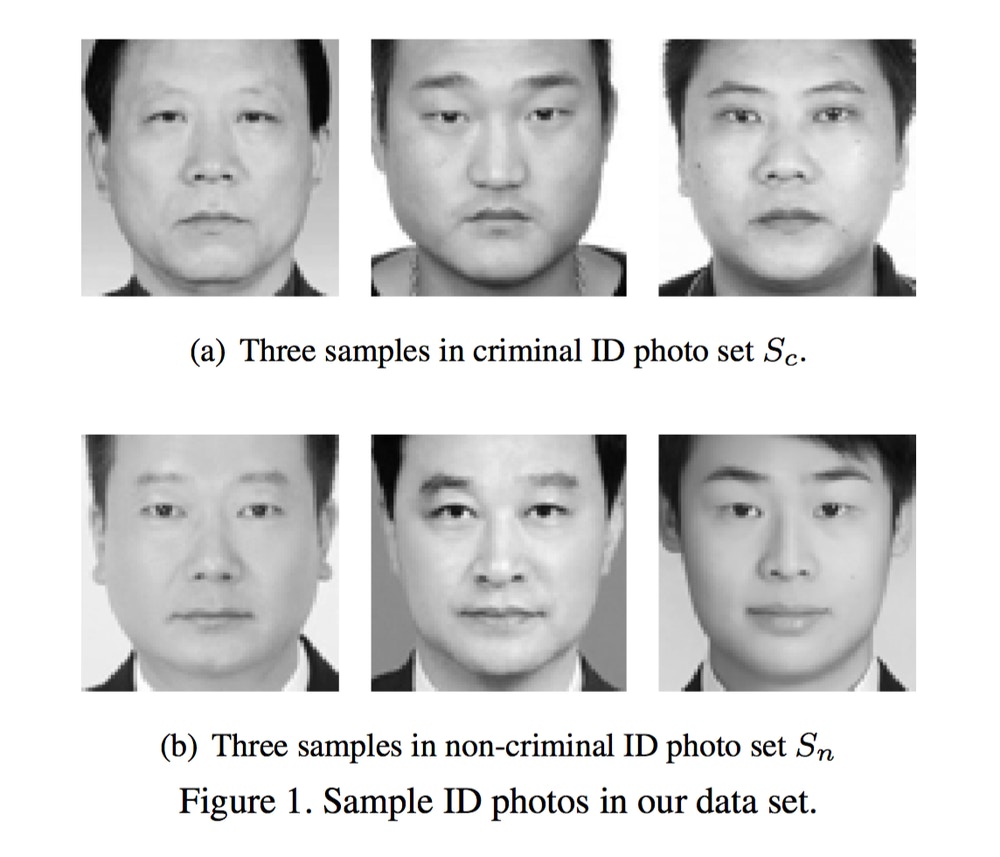

Erstaunlicherweise gibt es bereits mehrere Ansätze, Forschungen und Projekte, welche dies möglich machen wollen. 2016 haben Professoren und ein Student der Universität Shanghai Jiao Tong University einen Algorithmus entwickelt, welcher allein anhand des Gesichtes ablesen kann, ob eine Person kriminell ist oder nicht. Sie betonen, dass es bei dieser, anders als bei anderen Gesichtserkennungssoftwares, keine Vorurteile gegenüber einzelnen Bevölkerungsgruppen und Kulturen geben soll.

Studieder Harrisburg

University

Später hat die Harrisburg Universitiy die Veröffentlichung einer ähnlichen Studie, welche zu 80% akkurat sein soll, angekündigt. Mit diesem Algorithmus sollte es möglich sein, durch beispielsweise Überwachungskameras, kriminelle Menschen anhand ihres Gesichtes zu erkennen und sollte so die Verbrechensprävention voranbringen.

Kritik.

Schreibender CCT

Als die Studie der HU veröffentlicht wurde, löste dies große Diskussionen aus und stieß auf negative Resonanz. Die "Coalition for Critical Technology (CCT)", welche aus Forschern zu künstlicher Intelligenz, Historikern und Experten im Bereich der Ethik besteht, veröffentlichte als Antwort ein Schreiben, in dem sie fordern, dass die Studie nicht publiziert werden werden soll. Aufgrund dieser großen negativen Reaktionen, wurde die Arbeit letztendlich von der Universitätswebsite entfernt.

Der größte Kritikpunkt hierbei ist die stark ausgeprägte Möglichkeit des Rassismus, bzw. rassistischer Urteile. Auch wenn es die Entwicklern dieser Systeme es nie beabsichtigt haben, kann es durch voreingenommene, parteiische Datensätze, von denen der Algorithmus lernt, zu ebenso voreingenommenen Ergebnissen kommen (garbage in - garbage out).

Außerdem erinnert dieser Ansatz stark an die Idee der "Rassenlehre" von der bereits mehrere Male in vergangenen Jahrhunderten Gebrauch gemacht wurde, das wohl bekannteste Beispiel ist die Zeit des dritten Reiches.

Quellen und Links:

- Artikel zum Thema von "WIRED"

- Artikel zum Thema von "the interce"